Perusteellinen analyysi aivo-konerajapintoihin (BMI) liittyvästä eettisyydestä, jota alalla itsellään ei ole. Yleisesti ottaen eettisiä tutkimuksia ei tyypillisesti ole teknokraattien/transhumanistien alalla, koska se estää heidän teknologian kehittymistä. Teknokraatit keksivät, koska he voivat, eivät siksi, että niille on osoitettu tarvetta.

Lähde: Technocracy.news

En ole koskaan halunnut pystyä ohjaamaan laitteitani ajatuksillani. Olen täysin iloinen voidessani käyttää fyysistä käyttöliittymää, jonka voin sammuttaa, päästää irti tai kävellä pois. Entä sinä? Pidätteleeko näppäimistösi sinua? Hidastaako hiiri sinua? Haluatko vain ajatella postausta ilman, että sinun tarvitsee peukaloida sitä? Miksi kyborgialaista tekniikkaa painostetaan meille niin lujasti?

Onko kukaan pyytänyt sitä? Tarvitseeko kukaan sitä?

Tässä esseessä tarkastelen eettisiä tutkijoita, jotka herättävät huolta Brain Machine Interface (BMI) -tekniikasta, jonka ennustettu hyödyllisyys olisi kyky pyyhkäistä mielessäsi ja napsauttaa aivoaaltoillaan. Suoraan sanottuna en näe sille kysyntää, en edes halvaantuneille, koska meillä on aivoleikkauksista vapaat rajapinnat, kuten Stephen Hawkingin käyttämät. Lisäksi haluammeko todella, että impulsiiviset raivotviitimme lähetetään välittömästi?

Ei ei ei. Ei tämä tekniikka ole menossa sinne. Kukaan ei halua BMI:n suorittavan tavallisia tehtäviä uudella tavalla, varsinkaan jos se tarkoittaa outoa kypärää koko päivän tai aivoleikkauksen tekemistä. Porkkana ja keppi tässä on lupaus parantuneista henkisistä kyvyistä.

Näyttää siltä, että meillä on koordinoitu pelonlietsokampanja vakuuttaakseen meidät siitä, että transhumanoidut tekoälykyborgilegioonat ylittävät meidät henkisesti. Joten kaikkien on hankittava BMI pysyäkseen mukana. Valitettavasti, kun teemme tämän, aivomme ovat luettavissa kenelle tahansa, jolla on oikea ohjelmisto, emmekä pysty erottamaan omia päätöksiämme ja niitä, jotka on istutettu päähämme langattomien laitteiden kautta.

Neuroeetikot ehdottavat, että meidän on toimittava nopeasti , ehkä jopa kirjoitettava perustuslakimme uudelleen!

Minusta heidän uusien hermooikeuksia koskevien ehdotustensa tarkoituksena ei ole suojella meitä niin paljon kuin rajoittaa tapoja, joilla meitä voidaan loukata suuremman edun vuoksi. Neuroeettiset ovat susia lampaan vaatteissa. Katsotaan oletko samaa mieltä arviostani.

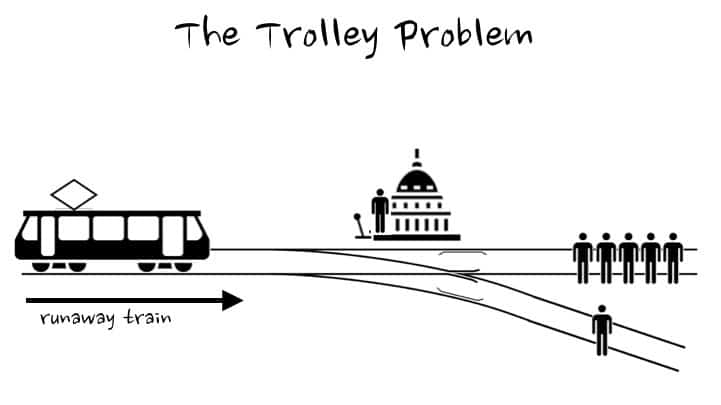

Laajemman kontekstin osalta katsotaanpa ensin niin sanottua “vaunun ongelmaa” etiikan alalla. Oletetaan, että mies käyttää vaihteistoa junapihalla. Jos karannut junavaunu on auraamassa viiteen työntekijään radalla, onko hänen moraalisesti velvollisuus vetää vipua ohjatakseen vaunun uudelleen siten, että se tappaa vain yhden työntekijän toisella radalla?

Saatat huomata, että olen tehnyt merkittävän muutoksen vakiokuvaan, joka on poistettu Wikipediasta ja kuvaa tätä ongelmaa. Vaihtajani ei toimi oman virastonsa alaisuudessa. Hän on hallituksen edustaja, joka toimii jonkin politiikan tai vakiomenettelyn mukaisesti. Siksi hän on kuvassa hallituksen rakennus takanaan. Tämä muutos muuttaa kaiken. Protokollan mukaan hänen on tapettava yksi mies pelastaakseen viisi.

Mutta kun toimet ovat automatisoituja, tahdonvoimaa ei ole, ja siksi miehen tekemistä ei voida kuvata valinnaksi toimia eettisesti. Vanhan ajan etitikot, esimerkiksi Aquino tai Kant, väittivät, että moraali lähtee toiminnasta vapaasti päättävästä agentista , mutta nykyään ajatus siitä, että yksilöllä on vastuu (ei vapaus, ei oikeus, vaan vastuu ) valita. oikean ja väärän välillä on vain kadonnut eettisestä keskustelusta.

Jose Munoz on Mind-Brain-ryhmässä Espanjassa, hän on myös Harvard Medicalissa ja muutamassa muussa todella tärkeässä paikassa. Tarkastellessaan kollegansa Nita Farahanyn työtä, hän tiivistää nykypäivän neuroeettikkojen lähestymistavan T:hen. Hän väittää, että meidän on “luotettava suuntaviivat hermooikeuksille”. (Ohjeet, se kuulostaa lempeältä, mutta ihmettelen, onko niillä sellainen voima kuin CDC:n ohjeilla, jotka pantiin täytäntöön kaikella lainvoimalla).

Munoz sanoo, että on käytävä keskustelua tutkijoiden, hallitusten, yritysten ja yleisön välillä. (Ihmettelen, kuka puhuu keskustelussa?) Hän sanoo, että “kansalaisille” on taattava pääsy heidän tietoihinsa. (Okei, minun täytyy hypätä läpi, jotta saan selville, mitä tietoja minusta on kerätty tietämättäni tai suostumattani, ja mitä sitten?)

Panen merkille sanan “kansalaiset” käytön ihmisten tai ihmisten sijaan .

Hän ei halua meidän unohtavan, että kansalaisina olemme valtion alalaisia . Hän uskoo myös, että “tällaista dataa koskevaa lukutaitoa on viljeltävä”, mikä on räikeä tapa sanoa, että ihmisille on kerrottava, mitä heidän pitäisi ajatella tiedonkeruusta. Milloin ihmisiä pyydettiin suostumaan tietojen keräämiseen? Mahdollisuus kieltäytyä tietojen keräämisestä ei kuulu tähän eettisten periaatteiden valikkoon.

Nykyään eettiset tutkijat näyttävät vain olettavan, että viime kädessä valtion on tehtävä nuo etiikkaa koskevat päätökset – tietysti konsensuksen pohjalta. Joten se on okei, koska se on demokraattinen toimivallan menetys. Pian tekoäly optimoi nämä päätökset puolestamme, meille kerrotaan. Yksittäisestä ihmisestä on tullut pelkkä väline, jonka kautta jonkun toisen “eettisiä” valintoja toteutetaan. Tämä ei ole eettistä. Tämä on vaarallista.

Voimme mukauttaa kärry-ongelman kysymykseen, pitäisikö yksilön tehdä henkilökohtaisia uhrauksia yhteiskunnan hyväksi vai ei. Alla oleva kuva esittää sellaista logiikkaa, jonka mukaan ihmisten pitäisi vaarantaa henkensä sodassa maansa edun vuoksi tai ottaa rokote, johon liittyy jonkin verran riskiä, koska se on välttämätön lauman immuniteetille.

Tässä esseessä en väitä, että yksilöllä on oikeus olla itsekäs ja päättää olla tekemättä henkilökohtaisia uhrauksia muiden oletetun edun vuoksi. Tästä syystä meidän ei tarvitse arvostaa yksilöllistä vastuuta yhteisen edun edelle. Arvostamme yksilöllistä vastuuta, koska jos yksilöitä pakotetaan, pakotetaan tai lahjoitetaan uhraamaan yhteisen edun hyväksi, on olemassa vakava vaara, että taho, jolla on valta määrätä politiikkaa, voi käyttää tätä valtaa vahingoittaakseen tahattomasti tai tahallaan.

Ainakin yksilöllisen vastuun myöntämisen jälkeen ongelmiin haetaan enemmän aivoja ja on enemmän mahdollisuuksia löytää hyviä ratkaisuja. Haluammeko todella käydä sotaa? Ovatko rokotteet todella turvallisia ja tehokkaita? Lisäksi yksittäisen henkilön tekemät virheet rajoittuvat yleensä pieneen piiriin. Poliittisten päättäjien tekemät virheet vaikuttavat koko väestöön.

Kolmen vuoden painajaisen jälkeen, jossa virheitä ei tehty – viitaten Margaret Anna Alicen runoon tällä otsikolla, jossa “filantropaatteja” ja muita johtajia syytettiin tarkoituksellisesta demokratiasta – meidän pitäisi suhtautua skeptisesti kaikkiin “eettisiin asiantuntijoihin”, jotka vaativat lisää uhrauksia. meistä muiden poliittisten päättäjien käsityksiin suuremmasta hyvästä. Mitä tulee C0vlD:hen, yksimielisyys kehittyy siitä, että he tekivät kaiken pieleen: lukitukset, naamiointi ja eristäminen, varhaisen hoidon ja uudelleenkäyttöön tarkoitettujen lääkkeiden pidättäminen sekä kokeellisen rokotteen edistäminen.

Viime aikoina kuulemme melko paljon tarpeesta määritellä ihmisoikeudet uudelleen, kun yhteiskunnallinen maisema sopeutuu uusiin teknologioihin, jotka muuttavat ihmisenä olemisen merkitystä. Väitetään, että tarvitaan uutta “Transhumanismin etiikkaa” pelastamaan meidät hakkereilta tai hallituksilta ja yrityksiltä, jotka saattavat haluta käyttää tekoälyä lukeakseen ajatuksiamme ja hallitakseen mieltämme.

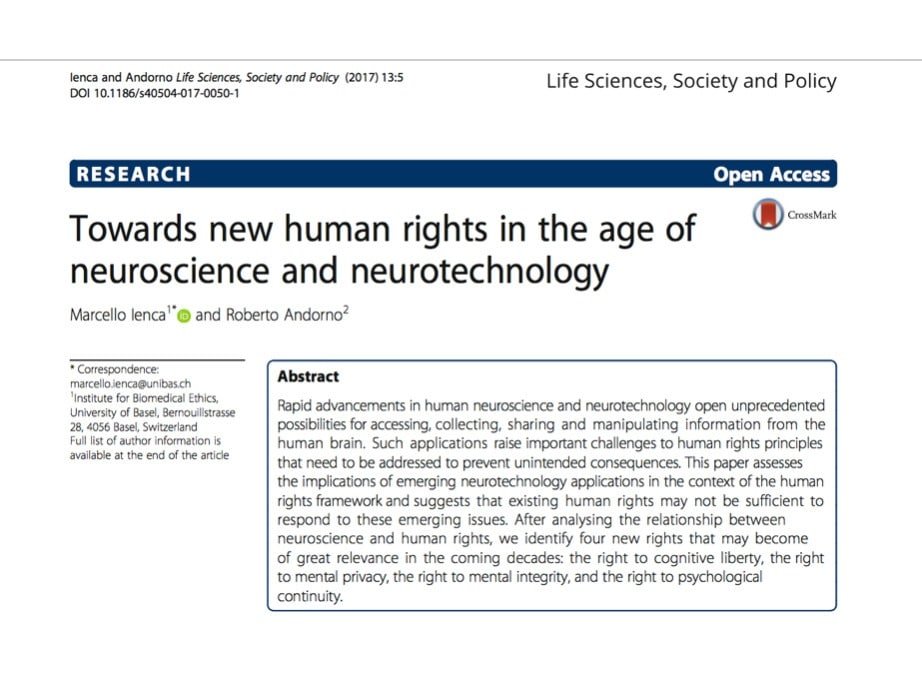

Ienca ja Andorno, “Kohti uusia ihmisoikeuksia neurotieteen ja neuroteknologian aikakaudella”, kirjoittajat panevat merkille, kuinka paljon tietoa Internetin käyttäjistä kerätään nyt, ja he olettavat, että uusi teknologia kerää myös aivodataa. He pohtivat seuraavia eettisiä näkökohtia:

”Mihin tarkoituksiin ja missä olosuhteissa aivotietoa voidaan kerätä ja käyttää? Mitä aivoinformaation osia tulee laillisesti paljastaa ja tuoda muiden saataville? Kenellä on oikeus tutustua näihin tietoihin (työnantajat, vakuutusyhtiöt, valtio)? Mitkä pitäisi olla suostumuksen rajat tällä alalla?”

He eivät edes mainitse selvempää väitettä, jonka mukaan kaikenlaista online-tiedonkeruuta voitaisiin pitää yksityisyyden loukkauksena. Kummallista kyllä, ensimmäinen oikeus, josta he keskustelevat tässä artikkelissa, on yksilöiden oikeus päättää käyttää uusia neurotekniikoita. Heidän keskusteluissaan oletetaan myös, että uudet teknologiat tekevät sen, mitä niillä mainostetaan tekevän. Ei keskustelua tarpeesta tehdä pitkäaikaisia tutkimuksia tai testata mahdollisia teknologiavirheitä. On muistettava, että C0vld-rokotteen hätäkäyttölupa oli perusteltu, koska sanottiin, että ihmisillä pitäisi olla oikeus halutessaan käyttää testaamatonta teknologiaa.

Keskustelussaan hermosolujen painostamisesta Chilessä Whitney Webb huomauttaa , että köyhät ja vailla olevat ohjataan BMI-tutkimuksen vapaaehtoisten linjan etupuolelle.

Olen sitä mieltä, että aikuisten pitäisi voida vapaasti halutessaan osallistua uusiin, mahdollisesti vaarallisiin hoitoihin, saada kaksois-D-rintaimplantteja, tehdä itsemurha, tehdä heroiinia, työskennellä prostituoituna tai kastroida itsensä. Mutta en usko, että on eettistä kannustaa tai mahdollistaa ketään itsensä vahingoittamiseen. Eettinen yhteiskunta yrittää yleensä auttaa ihmisiä näkemään, että heillä voi olla muita vaihtoehtoja. Emme halua rohkaista ihmisiä ottamaan riskejä, emme todellakaan tarpeettomia.

Ienca ja Andorno kertovat meille myös, että…

Suurin osa ihmisoikeuksista, mukaan lukien yksityisyyden suojaa koskevat oikeudet, ovat suhteellisia siinä mielessä, että niitä voidaan rajoittaa tietyissä olosuhteissa edellyttäen, että jotkin rajoitukset ovat välttämättömiä ja ovat oikeasuhteinen tapa saavuttaa laillinen tarkoitus. Erityisesti yksityisyyden suojaa koskevassa Euroopan ihmisoikeussopimuksessa todetaan, että tämä oikeus sallii joitain rajoituksia “levottomuuksien tai rikosten ehkäisemiseksi, terveyden tai moraalin suojelemiseksi tai muiden oikeuksien ja vapauksien suojelemiseksi.” (8 artiklan 2 kohta).

Tämä kuulostaa siltä, että eurooppalaisilla ei ole oikeuksia yksityisyyteen. heillä on etuoikeuksia, jotka voidaan peruuttaa milloin tahansa, kun valtio katsoo sen tarpeelliseksi.

Tiedetään hyvin, että jumalanmiljonääri Elon Musk, joka luopuu libertarismiin kohdistuvasta väitteensä, haluaa, että vaikka hän hyppiikin invasiivista Neuralink AI -tekniikkaansa, hallitaan tekoälyä koskevia määräyksiä, jotka istutetaan peruuttamattomasti ihmisen aivoihin voidakseen lukea niitä. Toistaiseksi testikädelliset eivät ole menestyneet niin hyvin , ja syksyn 2022 Show & Tell oli äärimmäisen tyrmäävä. Yksi niistä monista, joita heillä on ollut, ongelma oli se, että kädellisten aivoaaltokuviot tietylle kirjaimelle, jonka tekoäly oppi yhtenä päivänä, muuttuivat erilaiseksi kuvioksi viisi tai kuusi päivää myöhemmin.

Aikaisemmin Herakleitos ymmärsi, ettemme koskaan astu samaan jokeen kahdesti. Kaikki biologiset prosessit ovat dynaamisia ja jatkuvasti muuttuvia, erityisesti esiintulevat aivoaallot; niiden täytyy olla, koska maailma on myös. Elävien olentojen on jatkuvasti muututtava vain pysyäkseen enemmän tai vähemmän samana. Tietokonealgoritmit, eivät edes Deep Learning -algoritmit, eivät ole niin muovisia kuin aivoaallot.

Tuon surkean Show & Tellin ajoista lähtien Neuralinkiltä on evätty lupa saalistaa ihmisaiheita, toistaiseksi. Mutta epäilen, estääkö tämä tekniikkaan heitetty huono raha houkuttelemasta lisää hyvää rahaa. Sijoittajien on ansaittava pumppurahansa takaisin ennen kuin he kaatavat. FDA tulee paikalle.

En vastusta teknologista transhumanista kehitystä, joka auttaa ihmisiä voittamaan vaikeudet. Bionic käsivarret ovat mahtavia, ja jopa raajojen uudistaminen kuulostaa hyvältä ajatukselta, jota on pyrittävä huolellisesti. Mutta jokin ei ole oikein tässä keskustelussa BMI-tekniikasta ja neurooikeuksista.

Tänä vuonna Nita Farahany, oikeustieteen ja filosofian professori ja itseään kuvaileva nueroeetikko Duken yliopistosta, on mainostanut uutta kirjaansa, The Battle for Your Brain: Defending the Right to Think Freely in the Age of Neurotechnology , joka ei puolusta mitään laji. Tässä kirjassa hän ei anna ohjeita auttaakseen ihmisiä tekemään parhaita eettisiä päätöksiä itselleen ja perheelleen. Hän yrittää myydä eettisiä normeja pakotettavaksi meille kaikille.

Kirjassaan ja puheessaan Maailman talousfoorumin kokouksessa Davosissa Farahany ajattelee haaroittuneella kielellä. Esimerkiksi, kun hän alun perin puolusti ajatusta henkisestä yksityisyydestä ja “kognitiivisesta vapaudesta” (Voi, veli, täytyykö heidän keksiä niin kiusallisia uusia termejä?), hän myöntää nopeasti, että se ei ole ehdoton oikeus – koska loppujen lopuksi Yksi tärkeimmistä asioista, joita teemme ihmisinä, on yrittää ymmärtää, mitä kanssaihmisemme ajattelevat. Meidän on löydettävä tasapaino yksilöllisten ja yhteiskunnallisten etujen välillä, Farahany väittää. Tämä tarkoittaa, että päättäjät saavat päättää, mistä oikeuksista sinun on luovuttava.

Hän esimerkiksi sanoo, että saattaa olla hyvä idea saada kuorma-autoilijat käyttämään EEG-laitteita väsymyksen tarkkailemiseksi, yhteisen edun vuoksi. Jos he nukahtavat rattiin, he voivat tappaa viisi tai kuusi ihmistä. Voinko sen sijaan ehdottaa, että rekkamiehille maksetaan heidän tekemästään työstä kohtuullisen hyvää palkkaa, jotta he eivät halua ajaa kahdeksaa tuntia pidempään päivässä? Vaihtoehtoisesti voimmeko saada poliittiset edustajamme alistumaan kaikkien sähköpostiensa ja puheluidensa ja jopa henkilökohtaisten keskustelujensa jatkuvaan valvontaan? Koska heidän päätöksensä voivat mahdollisesti tappaa miljoonia ihmisiä.

Farahany kehuu henkilökohtaisia laitteita, jotka tarkkailevat biologisia tietoja niiden mahdollisuudesta antaa työntekijöille kvantitatiivisia tietoja suorituskyvystään, jotta he voivat tehdä “tietoisia itsensä parannuksia”. Se, että FitBits ovat niin suosittuja, hän väittää, osoittaa, että ihmiset ovat innostuneita siitä, että heitä seurataan ja pisteytetään. Mutta olen melko varma, että Amazonin varastotyöntekijät eivät vaadi neurofeedback-laitteita, jotka auttavat heitä olemaan kannattavampia osakkeenomistajille.

Pakkoseuranta ja väärä määrällinen arviointi on mielestäni epäeettistä.

Farahany myöntää, että tällaisen seurannan tulisi olla vapaaehtoista, ja uskoo, että työntekijät haluavat hyväksyä nämä laitteet itsensä kehittämiseen. Nykyään meillä on jotain samanlaista autovakuutuksen kanssa; ihmiset saavat alhaisemmat hinnat, jos he suostuvat valvomaan ajon aikana. Mutta aina kun yksityisyyden uhraamisesta tarjotaan palkkio, se ei ole eettistä. Se on pakottavaa. Köyhät alistuvat todennäköisemmin kuin rikkaat.

Onko työntekijän suoritusten seurannasta edes hyötyä?

Kuten Yagmur Denizhan väittää teoksessa ”Simuloitu koulutus ja kuvitteelliset teknologiat”, kun ihmiset joutuvat tilanteisiin, joissa heidät arvioidaan ansaittujen pisteiden perusteella – ei yleisemmän ja kokonaisvaltaisemman laadullisen arvioinnin perusteella – ovelat keskittyvät nopeasti järjestelmän pelaamiseen, jotta he voivat ansaita. enemmän pisteitä vähemmällä vaivalla ja heikommin laadukkaalla työllä. Mutta Farahany ei koskaan kyseenalaista oletusta, jonka mukaan työntekijöiden negatiivisen ja positiivisen palautteen antaminen on hyväksi tuottavuudelle.

Lähde: Technocracy.news